来源:艺术-小说 文:陆兴华

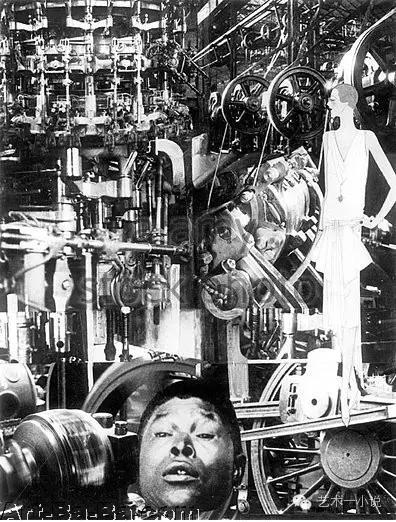

Movie scene from:'Berlin: Symphony of a Metropolis' (1927)

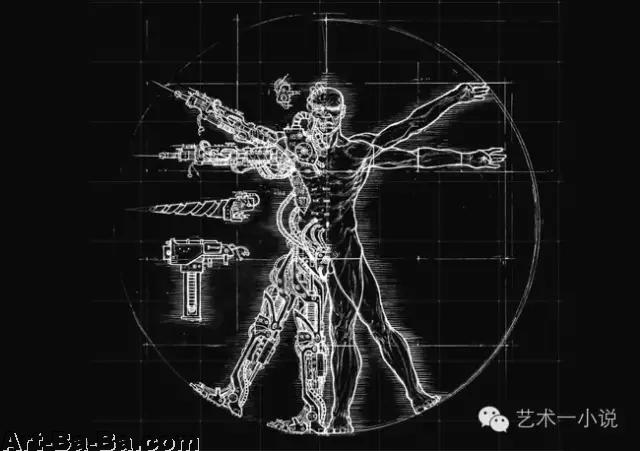

--当代大陆哲学眼光下的智力与人、机、脑之辩

【引】人工智能会战胜和替代人类吗?你只要一问这个问题,就输定了!被这个问题困扰,是因为说人工智能战胜和替代人类时,我们已抱了一种很可怕的关于“人”的在场形而上学:一边是人,一边是机器,机器战胜了人,好动漫!本文从人、脑、机三者的关系出发,基于德里达-马勒布的解构传统,来将“机器人战胜和替代人类”这样的问题置换成:有了人工智能后,如何给脑进一步升级?我们应该如何轻装上阵,不断自我变形,才能在未来更好地与脑共舞?

一、简答部分

(1)人工智能会战胜、代替人脑吗?不会。

(2)人工智能会威胁人类文明吗?不会,或者说,如果会,这类威胁也太挠痒痒了。

(3)人工智能会统治人类吗?除非被统治者花大钱请工程师团队来帮它天天升级来统治他们自己。这是花钱请工程师来统治我们。

(4)为什么大家动不动就爱说这下人工智能要来覆盖人脑,机器人要来统治人类了?因为埋在人们身上的意识形态-形而上学木马又起作用了:被统治者帮统治集团转移自己的归咎和反抗的方向。

二、人工智能统治不了脑

大脑是不断重新缠绕自己的(re-wiring),刻刻变移。所以,“内生(innate)和基因地决定的智力”这一有了近一百五年历史的说法,是错误的。最近十五年对基因组的研究表明,我们身上只有三万五千个左右的基因,在大脑中活跃的不到其中的一半。而且这些基因太弱,达不到脑的要求:基因无法对脑起决定性作用。法国脑科学家 Changeux认为我们的脑的复杂性更大,有它自己的生命,与基因无关,或者说身体基因是配不上它的。

人工智能也许能统治人(统治“人”的什么呢?当我们说“人”时,我们具体是指什么?),但它绝对统治不了脑。它本身也是模仿了脑之后的结果。关键在于脑能否被统治这一点上,是吧?那么回答是:脑是无法被统治的。脑非但不能被统治,马勒布还说,脑是我们抵抗全球资本主义企图占领我们的生命的每一面时的最后根据地(正面地看,抑郁症就是个人之脑对于全球资本主义压迫的自然反应)。脑被统治,意思只能是:电脑里的某个程序要来亲自开和关电脑了。大家还记得库布里克的《2001年太空漫游》最后的结局吗?机器人想要来管人的闭事了,人脑的反应很简单:关机。只有人脑会关机。机器人不会关闭自己,最怕这个。电影结尾我们听到的是机器人的可怜的哀求。

三、脑作为自然智力总是主动利用人工智能,在前-机器人时代就已如此

神经系统是一架机器。

--英国人工智能天才阿希比

马勒布认为,智能(intelligence) 和智力(intellect)之间是高度可塑的。当尼采在《人性,太人性…》里说“我为什么会这么聪明?”时,他的意思是:你看,我能避开你们众人的智能使用,用狐狸、蛇和鹰的角度来勇敢地思考,我培训出了一种特别的intellect,来对付你们的集体的intelligence(它也在我的脑中),我用另外一种聪明来对付你们的聪明,所以我是更聪明的。更聪明,也就是能站出现有智能之外,杀回马枪。智能和智力,只是这样的东西:事后追补上去的那一层东西。这也可解释今天的黑客方法论。

脑中就有自然的人工智能。

四、脑至少在同时经历四种进化,机器人只有可能战胜脑中的人工智能这一部分

脑中除了那一自然进化,至少被分子生物学家们津津乐道的,还有基因式进化、基因逆溯式进化和象征式进化。象征式进化的意思是,脑被符号和技术拖着进化:在生命的技术进化工程中,被不断假肢化和器官化(古人类学家勒鲁瓦-古昂称之为人的“外化”。脑是被外部自然所写,不全是生物自然进化的结果)。相信脑会被机器取代,智力会被电脑编程战胜,是只看到了第一种进化,忽视了后面的三种进化。在技术-数码化时代,后面的三种进化更明显了。脑的象征式进化意指:与人工智能打交道的脑会很快通过符号-技术支架来作出跳跃式进化,正如每一代儿童中间都会产生大量黑客一样。

脑在今天的数码算法海洋里仍可以游刃有余。人小,脑大。人的生命过程中发生的一切都可以影响人身上的自然,都是脑的学习机会,这就是脑的溯源式进化。它能看着办,有无限的余地。物理学家霍金在BBC和《卫报》上发言,担心人工智能会威胁人类文明,这论调是完全幼稚的(江晓原跟着他也写了同样的内容),表明他对脑科学和脑生物学最近二十年的研究一无所知。[1]

脑有巨大的“那么就看着办吧!”的能力。它不直接出手,但总是后来一步跟上。最后它总游刃有余。

布迪厄的社会学从另一角度理解了脑的社会式智力形成:智力不是智力地被设计的。我们的非理性unreason是被铭写在神经元中的。神经元是控制记忆的那部分。由于神经元的不同时地的侧控,脑在每一步上都可以做到无限地看着办!也就是可以彻底无厘头!布迪厄同时指出,脑在被动地跟着人做巨大的冒险,经受了一次次重大的考验。比如每一次人的情感经历都会使大脑裸露到巨大的危险之中,一次次,脑都必须撞墙而恢复,这种不断在创伤中自我修复,才渐渐形成一个人的脑性(cerebrality)。人的情性(dispositons)并不能决定一个人的脑性,是一次次 expositions决定了人一个人有什么样的脑性(就像弗洛伊德说一个人的儿童经历决定了它有什么样的sexuality一样)。布迪厄并不了解脑科学今天的重大发现,他只是要解释他的habitus理论,但完全符合今天的脑科学家们的观察:人的社会性学习,是先将自己放养到社会中,再创伤式地来综合经验和理解的(是脑必须靠这样来成长)。因而,布迪厄的社会学理论进一步证实:智力的形式一定是高度可塑的。它可以经受巨大的打击而又恢复过来。

智力是我们自己做出来(皮尔斯说的:智力是what we do and(加上) what we do with),不是现成的,我们一边做,一边带出了它,不是先有了它,我们再去用它。它不是现成可用的东西。皮亚杰的古典心理学就已关注到这一点。他指出,我们的智力是通过组织世界来组织它自己的。它看着办的,面对了机器人,它就像汪峰看上了章子怡。自然智力与人工智力的两分从一开始就是形而上学的。人工智能是自然智能的产物。

巴斯卡早就将automaton看作人的精神的“另一面”,是它的反派冤家,是不能少的配角。今天的人脑和机器人之间,亦是如此。问题肯定不是机器人或人工智能会否替代人类,而是:机器人将要把人脑拔高到什么程度?我们应该拿我们的脑怎么办?后面一个,就是马勒布的问题,也是她的那本著名的书的名字。

脑能够自动解散,就像电脑关机一样。失败后的修复和反扑,才显示出它的真正的能力。这就是黑格尔说的自我意识的克服过程。创伤后的恢复,到完全,到身体跟不上脑的彻底复原,这是脑的天然的能力。脑全新了,身体却还是那架烂机器,有部分脑科学家相信,老年痴呆症正源于此。

Movie scene from:'Berlin: Symphony of a Metropolis' (1927)

机器能够不中断自己,修补自己,在自我组织中重新定义自己。机器一失败,它就成了另一架全新的机器。伟大的算法学家和人工智能大师阿希比、明斯基、图林们都持这种看法。他们是因为相信了这一点,才相信人工智能模仿人脑是有前途的。

David Bates最近提出了“数码脑”的概念,来指出,与我们平时习惯地理解的相反,我们的脑早已是数码化的。所以,脑需要中断自己的自动化性(Automaticity),需要非机器人化。我们的脑总是想用最“懒”的方式存在,也就是说,脑总是想要像机器人那样存在和运行,因为这最省力。是机器跑来挑战我们的脑,说你千万别像机器那样,你再这样,我就要来逗你玩了。脑需要一次次被这样激活。人工智能的出现,等于是给我们的脑提供了一个很好的提醒装置。类似于智能手机对于我们的器官的作用。

五、那么如何解释IBM正在开发的脑神经元芯片?它不是已在模仿脑的一切?它的系统能够产生它自己的经验,这是不是说,脑的可塑性也可被编程了?

Spark Jones拍的科幻电影《她的(Her)》里,主人公萨曼莎是会经验人的经验的机器人女朋友,也能体验和期待自己的独特的人生,行为几乎像一个绿茶婊。她几乎是有脑的。百依百顺,既圣又婊。她是不是就要来统吃天下男人了呢?电影里,男主人公Theodore不久就难受起来,因为他发现:她只是一个技术妓女,按不同价位能买到,光这一条街上就有几十个用户在使用,拿到修理店去升级,与别的机器人女朋友放一起看,怎么都像宠物。主人公感到自己爱和睡这个机器人女友真是太蠢了。这不光是主人公的反应,更是人的有机脑的排斥性反应啊!

人的智力却总是无形的,在下一刻就吞下了它前面的自己。且刻刻都摇身一变。用心理学也是远远解释不清楚的。苹果手机一年换一个可以,机器人女朋友得一夜换一个才行啊,哪家制作公司能将成本降到这么低?

智力是一种无形式的形式,处于心灵(精神)与它自己的能力之间。黑格尔描述的“客观精神”的认识自己的过程,差强就是:它认识对象,然后成为了对象,把对象当作了自己,完了吗?没有!它接着往前走。“它是它自身的运动”!它永远在冲浪。它留下伟大的身后。伟大的变革、革命和沧桑只是它的配料。对于人,历史是活过的经验,而对于脑、意识或精神,这可能就不过是一堆备用的材料,像拍电影用的道具。与其问机器人会不会成为我们的历史主主人公,我们倒应该问问:我们是不是已进入了一种脑历史时代?人只是其配角?在大数据中,人越来越成为时时被重新编排的跑龙套的角色?

六、自然智力和脑是人工地可塑的

大学在今天已不在大学教师身上。在未来,大学将成为网络远程教育本身,那才是德里达说的“无条件大学”。那时,老师将是集体智性(collective intelligence)的激活者(animator)。

--法国社会学家Pierre Levi

以为机器人要来统治人类了,其实我们这还只是在初级阶段呢! 我们现在是ANI, N是narrow,大家就惊叫了。接下来我们还将进入AGI, G是general,一般地全面应用。最后会进入ASI, S是super,超级应用,那时就会有替代式的脑功能,某些方面比人脑更好,创造,会有社交技巧(牛津哲学家纳斯波姆的定义)。

电脑模拟的人工智能最后会有主体性经验?且可同时被继续编程?有一种叫做人工可塑性的东西?会有的。但这又有什么大不了的呢。人脑要它们有的。它要求找版本更高的配角和陪练。

一人一脑,对于你而言的脑到底是一个什么东西?数学家和天体物理学家们说的奇点?脑洞,是个人大脑深处最不可捉摸处?那一无法被编程的点?

Ex machina (2015)

智商无法通过基因传递。人的智能是人抵抗外部危险的盾牌。人的智力不靠量而靠张度来取胜。在人脑面前,机器人只是机器动物。

是人脑下放某部分智能给机器,而机器最近突然拎得清了,能够向人脑学习如何通过试错来学习了而超过车了。但机器人是永远学不到人脑的愚蠢和懒惰中潜伏的阴暗的伟大力量的。

人和机器之间没关系,是人脑和有人工智能机器之间的关系:人工智能从来是人脑的一部分。人脑从来自己主动在将人工智能当假肢。

机器战胜人,是太形而上学的说法。什么叫“战胜”?在评到阿尔法狗取胜时,斯蒂格勒指出,界面变成棋面,本来是好事,是将它变成一个一致性平面,会在其中生成新的欲望。在古典围棋中,“胜”就是那个将一盘棋下得开天辟地,将棋谱留给后人。而阿尔法狗做的,刚好与这种围棋精神相反,变成了更多的计算的投入。[2]

是人要机器人来当假肢的。这一围绕机器人编织的matrix,在下一秒里就被人甩在脑后了。景观和matrix那只是第三存留,对于人脑而言,只是像电影拍摄现场堆积的那些的东西。说机器人将来替代人,这是一种严重的形而上学迷糊:人陷在它自己的伟大创造中也就是机器和拟像之中了,《弗兰肯斯坦》就是这一老的理解套路,完全是形而上学式的昏庸看法。

其实,黑客帝国也就是人脑给它自己打的一个草稿。它只是人脑的脚手架。

平时,人脑也是陷于它的习惯之中。习惯是药罐。它帮助我们保持健康,同时却也加快我们的残废。它是我们用来战胜一恶的那一恶。我们对于苹果果手机的上瘾,对任何技术装置的上瘾,都属于这一习惯的一部分。[3]习惯导向残废。它同时是残废对我们的招引和威胁。它是残废本身。[4]当我们对技术产品上瘾,就是残废冲动冲了上风的时候。我们需要脑,来破除习惯。是脑拖着我们走出习惯,使自己可塑,逼自己变形。

七、什么叫做“人被机器人替代”?

黑格尔-科耶夫的关于人、历史和艺术的终结和尼采在《扎》里的“伟大的信号”一节中说的人终结于报复这一关于人终结的说法,被德里达在《哲学的边缘》中理解为1)完成, 2)消失。形而上学和人类学所理解的人,已完成,正在消失。

但德里达认为,人,是重复。它是一种自动机制,automatism。人重复自己,才是人;但人的本质如果已融化于数码-量子-纳米层面,它还能重复吗?它只能重复,在重复中留下的那一点点差异,哪怕那一点点踪迹,这之后,人才是人。人是它消失后返回来的那一点莫名其妙的东西了。

解构后,人重复的将是什么?被解构后,人类此在将是一种什么样的东西了?德里达提醒我们,黑格尔和胡塞尔都认为理性就是历史,历史只是理性,人不断回来,重新拾起它们:只有那一普遍人性的本质构成的理性,那一目的论理性,才是人。比如那一跨越至少二十五个世纪的几何共同体中的人类共认的理性,才是“人”。德里达总结,人正是那一带向终结的东西,在“终结”这个词的最根本的意义上讲[5]。人是一种不断完成和消失的东西。但人永远都仍回来。因此,我们作为“最后的人”,不应去做“高等的人”,而是成为“超人”。应该向尼采学习,走出形而上学,像《道德的谱系》所建议我们那样,去屋外跳舞,去跳出那一出积极的遗忘(aktive Vergeszlichkeit)之舞,进入残酷的节日,烧掉我们的文本,像野兽那样抹去我们身后的踪迹,用大笑,来照亮我们自己的非形而上学式的归来之路。在此之前,“我们必须同时说好多种语言,生产出好多种类的文本”。这是风格的改变,而只有改变风格,才能改变我们的地盘。[6]

尼采这样的启示性的见解,在今天的脑科学看来,是常识了。不要被人的尊严和本质这样的说法捆住。福柯和阿甘本式的对生物-权力的批判和抵抗,也仍是报复式的:想用另一种方式重新回到人的尊严和本质之中。这种“回到”是形而上学的。而相信人工智能会来替代人,更是像将人当退休人员在等死地认为人的尊重和本质是将来仍将如此,还需维护它!想要回到人那里,回到原来的样子,这就是尼采说报复。人终结了,也就是完成和正在消失,当人杀回来,它应该脱去形而上学之皮地全新地到来。这就马勒布说的变形。

人总要重复而回来,从今天的非人道主义话语中比如说脑学和分子生物学话语中偷偷潜回来的“人”什么样子的?

德里达说,人在一次次消失中重新完成自己。人是一种要结束但永远无法结束的东西。终结是人的telos,真要终结,人就无和不死的,达到绝对知识了。人处于将终结但没终结的夹缝里。终结是一个移动的界限。

无限地重复,是后-人类的新本质?

我们只能不断重塑人本身。人工智能只在这过程中能帮助到我们。当我们说人工智能战用和替代人时,我们是抱了一种很可怕的关于“人”的形而上学。

于是,马勒布倒转了讨论方向:在人工智能的帮助下,人本来可以快乐地变形了。但是,人是不会放过人工智能的。人要报复。如何使人不报复?因为,只有不报复,只有人不想回到它误认的人的本真状态,人才能快乐地变形,才能在今天的技术状态里游刃有余。

人是那种重复自己的东西。重复,是人的生活的原材料。人想要紧紧抓住记忆、先古性、谱系、修补、重新机构化…

计算机模仿人脑,是这一趋势的一部分。

Movie scene from:'Berlin: Symphony of a Metropolis' (1927)

我们问题应该是:人如何才能不带报复地去重复?如何才能不带残酷地去实现自己身上的那些非人道主义式、非人类学式的人性?

八、后记

什么是波洛克式的画?那是自动画,自动艺术:automatic art, 不刻意,但也不随便,介于真正的必然和无可奈何的偶然之间,是内在的外部和外部的内在嵌套在一起,使一切都处于溯源式的不确定之中,像灾难。像脑。是脑画。

--马勒布,“像波洛克的画那样--智能的变移”

关于机器人会不会来替代人这样的讨论,还只是浮现很表面的症状。深层的问题是,我们怎么拿我们原来的哲学、唯物主义眼光和康德要求于我们的作为公共地运用理性的既自启又启他的启蒙过程,来讨论这样的全新的问题?当我们直觉地就相信机器人要来替代人类时,也就间接承认原有的哲学和人文科学的批判眼光已全线失效了。在当前的紧迫问题前,它们的确已失效。这需要我们作出一些重大的转变,否则,我们就只能呆在哲学或人文科学里掩耳盗铃到天黑了。

用这些旧有的眼光去批判这些是不着边际,甚至危险的。讨论机器人会不会来替代人这样的问题时,我们必须:先将我们手上的哲学立场、理性主义话语和唯物主义世界观升级。马勒布向我们演示的方法是,主动利用分子生物学和脑科学对我们旧有的唯物主义立场的架空和否定,反而趁此机会,来克服我们的教条主义和形而上学,给我们自己身上的哲学立场全面升级。

这也将是未来文科的任务了。只有在这样的场内搏斗中,我们才能找到未来的文科的地盘。马勒布示范的是:在与脑科学和分子生物学的不断冒出来的颠覆式的新发现的搏斗般的认识过程中,去找到一种新的内在批判理论的边界,在这个边界内,来重新集结原有的大陆哲学资源,把康德、黑格尔、海德格尔和德里达升级后,再转而引用他们来讨论当代的紧迫的大问题。

这对于正陷于当前文科中的我这样的定居者们意味着什么?首先,我们必须主动直面这些一再突破原有本体论底线的科学发现,形成一种我们哲学圈内自己的“实验式批判”,能够站在我们自己的立场上对科学和脑科学的新发现作出内在批判,在与后者的扳手腕的过程中,发展出一种批判理论,同时给科学和脑科学来找到边界,以此来重新找到新文科的地盘。然后我们才能重新划定我们此时的文科与科学和脑科学三者之间的新边境。第三,升级我们熟悉的伟大作者、传统、资源、谱系,迎着当务之急地来给它们补上,使它们能在当代说得上话,并带着他们去讨论当前最热的技术-伦理话题。

这对于我们在今天如何阅读大陆哲学这一点,既构成了重大的警示,也带来了一条很好的出路:必须在当代先给康德、黑格尔、尼采、德里达做人工呼吸,救活它们,再让它们能够对比如说当前的重大脑生物学问题发言。直接去读康德或德里达,将是致命地教条主义和官僚主义的!

比如,马勒布就是这样来读康德的:她先问,今天的脑生物学到底应该支持基因(genetic)本体的,还是支持基因溯源(epigenetic)本体?康德对这事怎么看?她就将我们带到《纯》27节里。康德说:范畴与经验的先天和谐“因此打开了一个纯理性的溯源发生之系统(gleichsam ein System der Epigenesis der reiene Vernunft)”。但是康德生得太早了,并不知道今天的分子生物学、细胞生物学和脑科学在今天的那些发现,他只是在论证中给我们留了一个缺口而已:先验前定,是一条路子,而倒过来,溯源式理性,也是一条。那由此可以认定,康德是会同意今天的分子生物学家咬定的“溯源式基因”进化行为这一说法,康德一定会反对今天的很多细胞生物学家和一般公众仍顽固地在坚持的基因前定论(preformism)式的进化解释的。这就等于说在我们的当代语境中的实验式批判过程中救活了康德!可以用他来做事了。当斯蒂格勒说康德就是费里尼,《纯》就是一张唱片时,也是在这么做!我们必须从费里尼和戈达尔出发去理解康德,而不应该扛着康德来批判费里尼和戈达尔对吧,后者是太教条主义加官僚主义,注定是死路一条对吧?

今天的文科在做的全是灾难性的事:通过文化研究式的描述,来将一切弄得看上去都很正常。哪怕是批判和抵抗,也只是为了使现实看上去更正常些,是要复原,是要复仇,以牙还牙,最后失一得一。所以,text都被我们弄成了pretext(借口)。

但脑不是基因式地前定的。脑必须开放。而我们文科人在今天也不得不开始我们的“批判式脑文科实践”。如何在现在就开始我们的脑文科呢?

在今天,我们要怕的,不是人工智能的自动性,而是我们和我们的脑的自动性。我们必须干预和打破我们的脑的自动性,哪怕用人工智能,也在所不惜。

我们与其担心被机器人替代,还不如改变我们目前的人工智能设计哲学和我们的教育制度中的智力选拔制度。尤其是后者中,关于智力的那些旧的原则都应废除。如何来测试智力呢?

尼采是这方面的脑科学或人类智能专家。在《人性,太人性!》里,他已经对脑和智力有很好的认识。他认为,只通过考试,没有残酷的竞争、选择和失败,就不会知道谁更聪明,因为,聪明与否总是事后才知道的。所有的考试都是错的,因为它们基于先定的指标,测试了那些在后面的过程不一定用得到的智力指标,不让差异在重复中出现(像德勒兹说的那样),也不知道这些指标与未来的发展有啥关系,就打了分。尼采说,只有一路上最善于应变、精明地顺从、变形和主动掷骰子者,才是最聪明的。在航海、狩猎和医疗中,一个人的智力上的特异,总是远远地在智力测试之后很久,才渐渐冒出来一点点的。应该在这种差异出现之后才测试才对。但所有的社会测试几乎都做反了。

智力无法被测量,是变移的,它在人身上或脑中,是一种长期潜伏、等待最后时刻收网的能力。这是一种像闪电那样的能力。尼采认为他自己有这种能力。所以,他才自问:我为什么会这么聪明的呢?机器人永远摸不到边的,正是人或脑的这种能力。

附-1:霍金:人工智能将威胁人类文明

评:他的评论里有严重的形而上学纠缠:用在我的轮椅的听说系统中那一点初级人工智能是好的,但现在它发展得太高级了,会“毁灭人类”的。

Prof Stephen Hawking, one of Britain'spre-eminent scientists, has said that efforts to create thinking machines posea threat to our very existence.

He told the BBC:"The development offull artificial intelligence could spell the end of the human race."

His warning came in response to a questionabout a revamp of the technology he uses to communicate, which involves a basicform of AI.

But others are less gloomy about AI'sprospects.

The theoretical physicist, who has themotor neurone disease amyotrophic lateral sclerosis (ALS), is using a newsystem developed by Intel to speak.

Machine learning experts from the Britishcompany Swiftkey were also involved in its creation. Their technology, alreadyemployed as a smartphone keyboard app, learns how the professor thinks andsuggests the words he might want to use next.

Prof Hawking says the primitive forms ofartificial intelligence developed so far have already proved very useful, buthe fears the consequences of creating something that can match or surpasshumans.

附-2: 评江晓原的关于人工智能的轻浮的看法。

一开始,他说人工智能会夺走人的工作。这一看法在国外争论很激烈,还没定论的,江认为一定是这样的。然后,他脚一滑,马上就泥牛入海般地进入形而上学:“很简单,那就是科幻影片《黑客帝国》和《未来战士》中的世界——人类被人工智能征服、统治、压迫。”此公显然是科幻电影看多了! 他说,“研发军事用途的人工智能本质上和研发原子弹是一样的,就是一种更有效的杀人手段”。那么,原来,不是机器人要杀人,是人要用机器人杀人,对伐?绕了半天,仍不是机器人会”征服、统治、压迫”人!!江晓原的讨论里不光逻辑和概念混乱,而且,他对于自己的科学史立场毫无基本的方法论反思,走半步就淌进在场形而上学不能自拔。这个整天装大学问的科学史大师一讨论技术,就漏洞百出,大概是下定决心要掩耳盗铃和守株待兔到进棺材了。

江晓原:人工智能的近期威胁:大批失业、军事化

人工智能的近期威胁,有些现在已经出现在我们面前了。近期威胁基本上有两条:

第一条,它正在让很多蓝领工人和下层白领失去工作岗位。现在较低层次的人工智能已经在很多工厂里被大量采用。有些人士安慰人们说,以前各种各样新的技术被发明时,也曾经让一些工人失去岗位,后来他们不都找到新的岗位了吗?但是我认为人工智能不一样。媒体曾放过这样的消息,包括人工智能的从业者自己也都在欢欣鼓舞地展望,说人类现在绝大部分的工作岗位,人工智能都是可以替代的。果真如此,显然这个社会将会变成绝大部分人都没有工作的状态。对于这样的社会,人类目前没有准备好。今天如果有少数人没有工作,多数人有工作,多数人养着少数人问题不大,这样的社会是我们现有的社会制度和伦理道德结构能够承受的。但是如果颠倒过来,这个社会中有相当大的比例——且不说超过50%,按照那些对人工智能的展望,将来90%以上的工作岗位都会被人工智能取代。比如说人们想听一场报告,找个人工智能来做就可以了,说不定比现在的听起来还要来劲。

当这个社会大部分人都没有工作的时候,社会会变得非常不稳定。那么多没有工作的人,他们可以用无限的时间来积累不满,酝酿革命,于是就会危及社会稳定。无论东方还是西方,无论什么意识形态的社会制度,在这个形势面前都将黯然失色。所以说人类还没有准备好。

顺便再展望一下,既然90%以上的工作岗位都可以由人工智能来取代,那么“革命战士”这种工作岗位能不能由人工智能来取代?革命能不能由人工智能来发起和进行?当然也可能。但是想想看,这样的革命会带来什么呢?很简单,那就是科幻影片《黑客帝国》和《未来战士》中的世界——人类被人工智能征服、统治、压迫。

这是人工智能近期的第一个威胁,现在在很多工厂已经出现了。对工厂来说,这个级别的人工智能是很容易实现的。那些工厂的管理者说,我们换一个机器人上来,它的成本只不过是三个工人一年的工资,但是它们管理起来太容易了。管理工人很难,你让他加班他不愿意,加得多了他可能跳楼自杀或上街游行,而机器人你让它24小时一直干着都没有问题,管理成本又节省下来——管理成本往往是无形的,不那么容易计算。换用机器人很容易就可以收回成本,也许一年就收回来了。所以他们乐意用机器人取代工人。一些地方政府还通过政策鼓励当地的工厂用机器人来替代工人,换个角度想想,城市这样发展下去,不需要几年,几百万工人失去工作,到那个时候后悔就来不及了。

人工智能第二个近期的威胁,是由加入军队的人工智能带来的。但现在以美国为首的某些发达国家,最起劲的事情就是研发军事用途的人工智能。研发军事用途的人工智能本质上和研发原子弹是一样的,就是一种更有效的杀人手段。为什么埃隆·马斯克等人也号召要制止研发军事用途的人工智能,道理很明显:研发军事用途的人工智能,就是研发更先进的杀人武器,当然不是人类之福。

今天我们只能,而且必须抱着和当年搞“两弹一星”类似的心态,来进行军事用途的人工智能研发。军用人工智能就是今天的“两弹一星”。

比较理想的局面,是各大国坐下来谈判,签署限制或禁止人工智能的国际协议。目前国际上已出现一些这样的倡议,但仅来自某些学者或学术机构,尚未形成国家层面的行动或动议。

中期威胁:人工智能的反叛和失控

我们再来看人工智能中期的威胁——人工智能的失控。这种威胁媒体早有报道,但有一些人工智能的专家出来安慰大家,他们认为人工智能现在还很初级,即使战胜了李世石,不过是下个棋,即使它会作诗、写小说,它还是很低级的,所以不用担心。这种安慰非常荒谬。

我们都知道“养虎遗患”的成语,如果那些养老虎的人跟我们说,老虎还很小,你先让我们养着再说,我们能同意这样的论证吗?你让我们同意养老虎,就得证明老虎不会吃人,或者证明你养的不是老虎。要是老虎养大了,它要吃人了,就来不及了。

《黑客帝国》三部曲

这个成语非常适合用来警惕人工智能的失控。各种各样的科幻作品都有提及失控的后果,比如影片《黑客帝国》中,人工智能建立了对人类社会的统治,我们人类就完蛋了。我们为什么要研发出一个统治我们自己的超级物种?

当然,还有一部分专家说,想让我们提供关于人工智能这个“老虎”不吃人的证据,我们有啊,我们有办法让我们的人工智能不吃人,不反叛,变成不吃人的老虎——我们只需要给人工智能设定道德戒律。

围绕在人工智能中设定怎样的道德戒律,用怎样的技术去设定,专家们确实已经想过各种各样的方案了。但是这些方案可行吗?任何一个具体方案,如果仔细琢磨,就会发现都是有问题的。我们先不考虑具体的方案,我们只要考虑一个总体的情形,就足以让我们警惕。简单地说,如果通过为人工智能设置一些道德戒律,就指望它不会学坏,那么请想一想,我们人类到现在为止,能够做到让每一个后代都学好吗?答案是做不到。我们总是有一部分学坏的后代。对这些学坏的后代,难道家长和老师没有向他们反复灌输各种道德戒律吗?况且社会还有各种各样的法律制约,但仍然还有一部分人不可避免地学坏。从这个情形来推想,人工智能就算是你的一个孩子,你能确保他不学坏吗?

更危险的事情是,人工智能会比人类更聪明。现在人类有一部分后代学坏,还没有颠覆我们的社会,那是因为他们毕竟没有变成超人,总体跟我们是一样的。一小部分人学坏,大部分人还是可以制约他们。要是那个学坏的人是超人,他掌握了超级智能后依然学坏,人们将没办法控制它。然而现在人工智能研发追求的是什么境界——不弄出“超人”来,科学家肯罢手吗?

所以,那些盲目乐观,说我们能让人工智能不学坏的人,请先解决怎么确保我们人类自己的后代不学坏吧。如果人类不能在总体上杜绝我们后代的学坏,那对人工智能不学坏的信心从何而来?

在考虑人工智能的中期威胁时,还必须考虑人工智能与互联网结合的可怕前景。主要表现为两点:

1、互联网可以让个体人工智能彻底超越智能的物理极限(比如存储和计算能力)。

2、与互联网结合后,具有学习能力的人工智能,完全有可能以难以想象的速度,瞬间从弱人工智能自我进化到强人工智能乃至超级人工智能,人类将措手不及而完全失控。

另外,鼓吹人工智能的人在安慰公众时,还有一个非常初级甚至可以说是相当低幼的说法:“我们可以拔掉电源”。专业人士在试图打消公众对人工智能的忧虑时,也经常提到这一说法。但实际上他们完全知道,如今人工智能已经与互联网密切结合——事实上,这一点正是许多大企业极力追求的,借用如今高度发达的定制、物流、快递等社会服务,人工智能几乎已经可以摆脱对所有物理伺服机构的依赖。而当人工智能表现为一个网上幽灵时,没有机体和形态,将没有任何“电源”可拔。

人工智能和互联网结合以后,危险成万倍增长。以前对于个体的人工智能,它智能的增长还会受到物理极限的约束,但一旦和互联网结合,这个物理极限的约束就彻底消失了。所以人工智能可以在极快的时间里自我进化。

去年一篇很长的文章在很多圈子里疯传,那篇文章稍微有点危言耸听,但结论我同意。作者想论证这样一种前景,就是说人工智能一旦越过了某个坎之后,自我进化的速度是极快的,快到不是以年月来计算,而可能是以分钟甚至是秒来计算。一瞬间它就可以变成超人。一旦变成超人,当然就失控了。因此说老虎还小的人,不要以为老虎跟现在一样一年长大一点,如果这个老虎一分钟长大一倍,这样的老虎还了得?虽然现在很小,过五分钟就能吃人了。

当然,对于这种事情,我本质上是乐观主义者,虽然我看到了这样危险的前景,我也还是得乐观地生活。只能如此,不能因为觉得末日可能要来临了,就不过好自己的每一天。

[1]见本文附录。

[2] 2016年3月28日中国美术学院学演讲,“屏幕与棋盘”。

[3]马勒布,《明天之前》,262。

[4] 285。

[5]德里达,《哲学的边缘》,147。

[6]德里达,《哲学的边缘》, 163。尼采说在《扎》中的“伟大的信号”一节说,人是到达超人的桥梁。到了后,人就不回来了,人烧毁了它的文本。这被尼采称作积极的遗忘。积极地遗忘自己,才是伸张了权力意志。而重复,是复仇,是陷害,是迫害。“人就是报复”,尼采说。上帝惩罚人,但它不报复。动物也不会报复。报复是太人性的特点。

复仇是因为人失去了遗忘的能力。人不能了结过去,所以人终结了,这可以算作一种解释。海德格尔在解释尼采的这一段时指出,人要报复的,是时间本身,时间是人的精神伤创,时间是对人的终极伤害。

而法是报复的精神名称。人总是还在,没终结,没消失。人为了成为人而要报复。

金锋工作室编辑